Marketing data-driven nell'era dell'AI: come i dati diventano decisioni (e i risultati si misurano)

C'è un momento che quasi ogni responsabile marketing ha vissuto almeno una volta. Ti siedi davanti a una dashboard piena di numeri, il board aspetta una raccomandazione sul budget del prossimo trimestre, e ti accorgi che tutta quella roba sul monitor non ti sta dicendo quello che ti serve sapere. Non perché manchino i dati. Perché i dati che hai non rispondono alla domanda che ti è stata fatta.

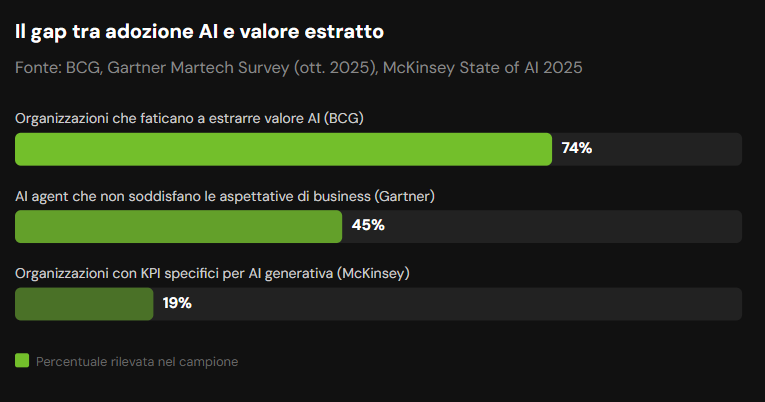

Siamo nel 2026. Le aziende hanno più strumenti di analytics che mai. L'AI genera report automaticamente, ottimizza le campagne in tempo reale, produce insight su comportamenti e segmenti che dieci anni fa avrebbero richiesto un team di analisti. Eppure il BCG rileva che il 74% delle organizzazioni fatica ancora a produrre valore concreto e scalabile dalle proprie iniziative AI. Gartner, su un campione di 413 responsabili martech intervistati tra giugno e agosto 2025, trova che il 45% ammette che i propri AI agent non soddisfano le aspettative di business dichiarate. McKinsey calcola che solo il 19% delle organizzazioni traccia KPI specifici per l'AI generativa che ha già adottato.

Questi non sono numeri sull'AI. Sono numeri sul processo decisionale. L'AI ha reso più comodo non pensare, perché c'è sempre un report automatico che sembra rispondere alla domanda. Il problema è che risponde a una versione semplificata della domanda, e spesso quella versione semplificata porta a decisioni che non cambiano nulla di importante.

Quello che segue non è una guida agli strumenti. È un ragionamento su come si costruisce il collegamento tra dato e decisione nell'era in cui l'AI è ovunque, ma il pensiero strategico rimane irrimediabilmente umano.

Il dato che non diventa decisione

Nel marketing esiste un'attività che consuma tempo senza produrre risultati: guardare i dati senza sapere cosa farne. Non è pigrizia. È la conseguenza diretta di costruire sistemi di misurazione senza partire dalle decisioni che quei sistemi devono supportare.

Un team marketing medio nel 2026 ha accesso a GA4, alla piattaforma pubblicitaria di Meta, al CRM, spesso a uno strumento di BI come Looker Studio o Tableau. Ognuno di questi sistemi produce metriche. Molte di quelle metriche vengono guardate ogni settimana. Pochissime cambiano effettivamente il comportamento del team quando variano.

Questa è la distinzione che conta. Una metrica utile è quella che, quando cambia, fa cambiare qualcosa. Se il tasso di apertura delle email scende e nessuno fa nulla, quella non è una metrica: è decorazione. Se il costo per acquisizione su Meta sale del 30% e il budget rimane invariato perché "aspettiamo di vedere se è una tendenza", quella dashboard non sta guidando nessuna decisione.

Il problema non è nuovo. L'AI lo ha amplificato perché ha moltiplicato la quantità di metriche disponibili senza cambiare la qualità del processo con cui le usiamo. Un responsabile marketing riceve oggi mediamente tre volte più report automatizzati rispetto al 2022. Non tre volte più chiarezza.

Il punto di partenza non è "quali dati ho?" ma "quale decisione devo prendere, e qual è l'informazione minima necessaria per prenderla bene?"

Questa inversione sembra banale scritta così. In pratica, richiede di abbandonare anni di abitudini costruite attorno alla disponibilità dei dati piuttosto che alla loro utilità decisionale. Richiede di fare una domanda scomoda a una serie di KPI che si usano da tempo: "se questo numero cambiasse domani, cosa faremmo di diverso?"

Se la risposta è "niente", quel numero non è un KPI. È un numero.

Cosa significa davvero "data-driven" nel 2026

"Data-driven" è diventata un'etichetta. La usano aziende che prendono decisioni basandosi su due righe di un report mensile. La usano team che non hanno mai eseguito un test A/B serio. La usa chiunque abbia installato Google Analytics, il che nel 2026 include praticamente tutte le aziende con un sito web.

La definizione operativa è molto più semplice, e molto più esigente. Un'organizzazione è data-driven quando le decisioni rilevanti che prende, budget, posizionamento, allocazione delle risorse, sono modificate dai dati che raccoglie. Non informate. Modificate. C'è una differenza sostanziale tra le due cose.

"Informate dai dati" significa che i dati vengono letti prima di prendere la decisione. "Modificate dai dati" significa che senza quei dati la decisione sarebbe stata diversa. Il secondo caso è raro. È il caso in cui vale la pena investire in analytics.

Nell'era dell'AI questa distinzione è diventata più difficile da mantenere. Gli strumenti producono raccomandazioni automatiche che sembrano decisioni basate sui dati. Tecnicamente lo sono. Ma se nessuno nel team capisce perché quella raccomandazione viene fatta, su quali segnali si basa e quale proxy sta ottimizzando, si sta delegando il processo decisionale a un sistema che non conosce il contesto del business. E il contesto del business è quasi sempre il fattore più rilevante.

Il McKinsey State of AI 2025 rileva che le organizzazioni che ottengono valore reale dall'AI hanno una caratteristica comune: hanno definito processi espliciti per stabilire quando e come validare l'output dei modelli con giudizio umano. Non si fidano ciecamente dell'AI. La usano come input in un processo che rimane governato da persone che capiscono il perimetro del business.

Perché l'attribuzione che usi racconta una storia parziale

Se c'è una cosa che il marketing data-driven ha sbagliato sistematicamente negli ultimi quindici anni è l'attribuzione. L'AI ha reso la situazione più complicata, non più semplice.

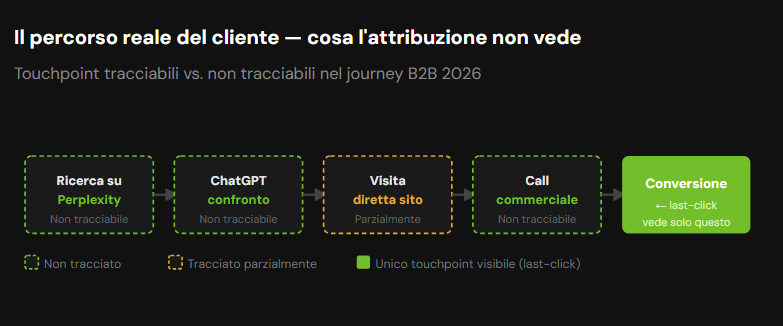

Un modello di attribuzione cerca di rispondere a una domanda precisa: quale touchpoint ha contribuito a questa conversione, e in che misura? La risposta corretta richiederebbe di osservare ogni singola interazione che un cliente ha avuto con il brand prima di comprare, pesare ciascuna correttamente, e isolare l'effetto causale di ogni canale. Questo è tecnicamente impossibile in modo esatto. Quindi tutti i modelli di attribuzione sono approssimazioni. Il problema si presenta quando si dimentica che sono approssimazioni e si prendono decisioni di budget significative come se fossero fatti.

Il last-click, ancora il modello di default in molti sistemi, assegna l'intero credito all'ultimo touchpoint prima della conversione. È semplice da implementare e sistematicamente fuorviante: ignora tutto quello che ha costruito l'intenzione d'acquisto. Il first-click fa l'errore opposto. I modelli lineari distribuiscono il credito in parti uguali tra tutti i touchpoint, onesti nell'ammettere l'incertezza ma inutili per ottimizzare qualcosa.

GA4 offre un modello data-driven che stima la probabilità di conversione per ogni touchpoint, ma richiede volumi significativi di dati e, soprattutto, dati completi. Ed è qui che il problema si aggrava nel 2026. Una quota tra il 20% e il 40% delle conversioni reali non arriva nei sistemi di tracciamento tradizionali, per effetto di ad blocker, ITP di Safari e configurazioni non ottimizzate. Un modello data-driven costruito su dati incompleti non produce insight più accurati. Produce errori più sofisticati.

A questo si aggiunge il problema del percorso d'acquisto nell'era AI. Una persona che sta valutando un acquisto B2B nel 2026 potrebbe aver letto tre articoli su Perplexity, chiesto a ChatGPT un confronto tra fornitori, visitato il sito direttamente senza passare per nessuna fonte tracciabile, poi convertito dopo una call commerciale. Il sistema di attribuzione vedrà l'ultimo click, o nel caso migliore l'ultima sessione. Non vedrà nulla di quello che ha costruito quella decisione d'acquisto.

L'approccio più affidabile nel 2026 combina attribuzione statistica per le decisioni tattiche con test di incrementalità per quelle strategiche di budget. Non è il più facile. È quello che risponde alle domande che contano davvero.

Un test di incrementalità, in sintesi, misura quante conversioni in più si sono generate grazie a una specifica campagna, rispetto a cosa sarebbe successo senza. Si esegue sospendendo o riducendo la campagna su un segmento di controllo e confrontando i risultati. Non è rapido, non è automatizzabile in modo triviale, e produce risultati che spesso smentiscono le narrative consolidate sui canali "che funzionano". Per questo motivo, pochissimi team lo fanno con regolarità. Per questo motivo, vale quasi sempre la pena farlo.

L'AI non ha risolto il processo decisionale. Lo ha reso più confortevole

Ogni grande promessa tecnologica degli ultimi vent'anni ha incluso una variante della stessa affermazione: "con questo strumento, prenderai decisioni migliori più velocemente." I CRM lo dicevano nei primi anni Duemila. Le piattaforme di marketing automation lo dicevano nel 2010. Le CDP lo dicono ancora oggi. L'AI generativa nel marketing non fa eccezione.

In parte, la promessa è fondata. L'AI analizza segnali che un analista umano non riesce a processare in tempo reale, ottimizza le offerte pubblicitarie a una granularità che manualmente sarebbe impossibile gestire, individua segmenti di comportamento non ovvi nei dati di navigazione. Queste non sono capacità marginali.

Il problema è il salto logico che molti team compiono: dall'AI che ottimizza le campagne, all'AI che guida la strategia. Il primo caso funziona perché il problema è ben definito, i dati di feedback sono immediati e la metrica di ottimizzazione è chiara. Il secondo caso è molto più difficile, perché le decisioni strategiche richiedono contesto, giudizio su priorità in conflitto, e la capacità di distinguere tra un segnale reale e il rumore di breve periodo.

Il Gartner Martech Survey dell'ottobre 2025 è esplicito su questo. L'89% dei responsabili martech si aspettava benefici significativi dagli AI agent adottati. Il 45% ammette che quelle aspettative non si sono avverate. La causa principale citata non è la qualità degli algoritmi: sono le lacune nell'infrastruttura dei dati e la mancanza di processi chiari per integrare l'output dell'AI nelle decisioni umane.

In altri termini: l'AI non funziona se non si sa già, prima di adottarla, quali domande deve rispondere e come quelle risposte entreranno nel processo decisionale del team. Questo è il lavoro che viene saltato quasi sempre, perché è meno visibile dell'implementazione dello strumento, richiede conversazioni interne più scomode, e non produce nessuna demo brillante da mostrare al board.

Il risultato pratico è quello che i dati confermano: adozione vicina alla saturazione, valore estratto ancora concentrato su una minoranza di organizzazioni. Non perché gli altri abbiano scelto gli strumenti sbagliati. Perché nessuno aveva aggiornato il processo decisionale prima di comprare lo strumento.

Dal dato alla decisione: il metodo

Il framework che segue nasce dall'osservare dove si rompe il processo nelle organizzazioni con cui lavoriamo. Si rompe quasi sempre nello stesso punto: si costruisce prima il sistema di raccolta dei dati e poi, a posteriori, si cerca di capire cosa farne.

La sequenza corretta è l'inversa.

Primo: mappare le decisioni, non le metriche. Si inizia dall'elenco delle decisioni rilevanti che il team marketing prende regolarmente. Quali canali attivare o disattivare. Come riallocare il budget tra campagne. Quale contenuto produrre. Su quali segmenti concentrare le risorse commerciali. Per ciascuna di queste decisioni, una domanda: su quale base la stai prendendo oggi? Intuizione, abitudine, o dato verificabile?

Secondo: per ogni decisione, definire la metrica minima necessaria. Non l'ideale: la minima. Qual è l'informazione che, se avessi, cambierebbe effettivamente la tua decisione? Questa domanda è più difficile di quanto sembri, perché la risposta onesta rivela quasi sempre che buona parte delle metriche che si monitorano abitualmente non entrerebbe nella risposta.

Terzo: auditare la qualità dei dati che alimentano quelle metriche. Questo è il punto in cui il lavoro sull'infrastruttura del dato diventa non negoziabile. Se la metrica che serve per decidere si basa su dati incompleti o modelli di attribuzione non affidabili, la pulizia dell'infrastruttura precede tutto il resto. Non si costruisce un processo decisionale solido su fondamenta traballanti.

Quarto: stabilire la frequenza di revisione per tipo di decisione. Questo passaggio viene quasi sempre saltato. Decisioni operative richiedono dati in tempo reale e revisione frequente. Decisioni tattiche richiedono dati aggregati su periodi più lunghi. Decisioni strategiche richiedono trend e confronti year-over-year. Usare la stessa cadenza per tutti i livelli porta a due errori che si sommano: si reagisce al rumore di breve periodo nelle decisioni strategiche e si ignorano i trend importanti in quelle operative.

Il ciclo decisionale nella settimana lavorativa concreta

Un ciclo decisionale data-driven non è un processo mensile di revisione della dashboard. È una struttura che definisce chi guarda cosa, con quale frequenza, e quali azioni ne conseguono. Senza questa struttura, la revisione dei dati è un'attività di reporting, non di decisione.

Nelle organizzazioni che funzionano bene su questo, ci sono tre livelli separati e deliberatamente tenuti separati.

Livello operativo. Lo gestisce chi esegue le campagne, con revisione settimanale su metriche di performance immediata: CPC, CTR, tasso di conversione della landing, punteggio di qualità. Le decisioni a questo livello sono rapide e reversibili: aumentare un budget, sospendere un gruppo di annunci, testare un'alternativa creativa. Nessuna di queste scelte richiede approvazione del management.

Livello tattico. Lo gestisce il responsabile canale o il marketing manager, con revisione mensile su metriche di efficienza aggregate: contributo per canale, costo di acquisizione per segmento, volume e qualità dei lead generati. Le decisioni a questo livello sono meno frequenti e producono effetti a 60-90 giorni: spostare budget tra canali, cambiare la priorità dei contenuti, rinegoziare con fornitori.

Livello strategico. Lo gestisce il CMO o il management, con revisione trimestrale su metriche di business: revenue attribuibile al marketing, LTV dei clienti acquisiti per canale, AI Share of Voice nei motori generativi, NPS e brand awareness nel segmento target. Le decisioni a questo livello definiscono il piano per i successivi sei-dodici mesi.

La problematica che si presenta più spesso è che il terzo livello viene discusso con i dati del primo. Si portano al board metriche di campagna perché sono le uniche prontamente disponibili e comprensibili da tutti. Si finisce per discutere del CTR di un annuncio quando la domanda reale è se il posizionamento di brand sta funzionando. Non è un problema di strumenti. È un problema di disciplina su quale dato appartiene a quale conversazione.

Framework decisionale: tipo di decisione, metrica, fonte e cadenza

| Tipo di decisione | Metrica affidabile | Fonte del dato | Frequenza |

|---|---|---|---|

| Ottimizzazione campagne paid | CPA effettivo, ROAS per gruppo annunci | Piattaforma ads + conversioni server-side | Settimanale |

| Allocazione budget tra canali | Contributo incrementale per canale | Test di incrementalità + GA4 data-driven | Mensile |

| Priorità contenuto editoriale | Citazioni AI, traffico qualificato, lead da organic | Search Console + tool monitoraggio GEO | Mensile |

| Posizionamento e messaggi chiave | AI Share of Voice, brand sentiment nei LLM | Monitoraggio generativo (Perplexity, ChatGPT) | Trimestrale |

| Investimento su nuovi canali | CAC per canale, LTV per coorte acquisizione | CRM + dati di retention | Trimestrale |

| Strategia annuale di budget | Revenue attribuibile, mktg contribution margin | ERP / finance + CRM integrato | Annuale + revisione semestrale |

Domande frequenti

Cosa significa marketing data-driven nell'era dell'AI?

Marketing data-driven significa prendere decisioni basate su dati verificabili invece che sull'intuizione o sulle abitudini consolidate. Nell'era dell'AI il concetto si è complicato: gli strumenti producono automaticamente insight, report e raccomandazioni, ma questo non equivale a migliorare le decisioni. Un approccio davvero data-driven richiede di definire prima quali decisioni contano, poi di costruire il sistema di misurazione che le alimenta, non il contrario.

Perché l'AI non risolve automaticamente il problema delle decisioni di marketing?

L'AI automatizza la produzione di report e ottimizza campagne in tempo reale, ma non cambia il processo con cui un team decide cosa fare. Il McKinsey State of AI 2025 mostra che solo una piccola quota di organizzazioni estrae valore misurabile dall'AI. Il motivo principale è che gli strumenti vengono aggiunti a processi decisionali invariati, alimentati dagli stessi modelli di attribuzione che non funzionavano già prima.

Quali KPI usare per misurare il marketing nell'era dell'AI?

I KPI dipendono dalle decisioni che si devono prendere, non dall'abitudine. Per decisioni di budget: il contributo incrementale per canale, non il ROAS last-click. Per decisioni su contenuto e visibilità: le citazioni nei motori generativi (AI Share of Voice), non solo il traffico organico. Per decisioni di retention: LTV e tasso di ri-acquisto, non solo il CAC. Il criterio operativo è semplice: un KPI è utile se, quando cambia, cambia qualcosa nel comportamento del team.

Come funziona l'attribuzione marketing nel contesto dell'AI?

L'attribuzione cerca di capire quale touchpoint ha contribuito a una conversione. I modelli classici assegnano il credito in modo arbitrario e ignorano la maggior parte del percorso reale del cliente, che oggi passa attraverso ChatGPT, Perplexity, ricerche vocali e canali non tracciabili. I modelli data-driven di GA4 migliorano la situazione ma richiedono dati completi per funzionare.

L'approccio più affidabile nel 2026 combina attribuzione statistica con test di incrementalità per le decisioni strategiche.

L'approccio più affidabile nel 2026 combina attribuzione statistica con test di incrementalità per le decisioni strategiche.

Cosa sono i test di incrementalità e perché sono importanti?

Un test di incrementalità misura l'effetto causale di un'attività di marketing: quante conversioni in più si sono generate grazie a quella specifica campagna, rispetto a cosa sarebbe successo senza. Si esegue sospendendo o riducendo una campagna su un segmento di controllo e confrontando i risultati. È lo strumento più onesto per rispondere alla domanda che i modelli di attribuzione non riescono a rispondere: questa spesa sta davvero generando vendite aggiuntive?

Con quale frequenza dovrebbe essere rivisto il piano marketing basato sui dati?

Dipende dal tipo di decisione. Le decisioni operative vanno riviste ogni settimana con dati in tempo reale. Le decisioni tattiche ogni 4-6 settimane con dati aggregati. Le decisioni strategiche ogni trimestre con dati di tendenza a lungo termine. Unificare tutte le revisioni sulla stessa cadenza porta quasi sempre a reagire al rumore di breve periodo nelle decisioni sbagliate.

Quali metriche di marketing si dovrebbero smettere di usare?

Non quelle che sembrano brutte, ma quelle che non cambiano nessuna decisione quando variano. In pratica: il traffico organico totale senza distinguere intento e qualità, il ROAS last-click su campagne assistite da altri canali, il numero di lead grezzi senza qualificazione, le sessioni come proxy del coinvolgimento. Meglio poche metriche che guidano azioni concrete di molte che finiscono in un report che nessuno aggiorna.

Come si costruisce una cultura data-driven in un team marketing?

Il punto di partenza non è la formazione sugli strumenti. È l'accordo su quali domande il team deve essere in grado di rispondere ogni settimana, ogni mese, ogni trimestre. Una volta stabilite le domande, si identificano i dati necessari per rispondervi e si verifica se esistono, sono affidabili e sono accessibili. La cultura data-driven non si costruisce installando GA4 o comprando Tableau. Si costruisce abituando il team a collegare ogni metrica a una decisione possibile.