GEO Tecnica: rintracciabilità,

accessibilità e leggibilità

Riscrivere le regole del gioco nell'era AI

La rivoluzione innescata dai Large Language Models (LLM) sta cambiando radicalmente le dinamiche della ricerca online, ponendo fine al lungo monopolio di Google e impattando pesantemente sulle decisioni di acquisto degli utenti.

Per anni l'agenda della SEO tecnica è stata dettata da Google, la cui continua evoluzione ha permesso di sdoganare progressivamente molte soluzioni di sviluppo dei siti che un tempo rappresentavano dei vincoli invalicabili. Si pensi, ad esempio, all'uso di qualunque soluzione che preveda esecuzione di codice per il corretto rendering delle pagine o l'iniezione di meta informazioni e dati strutturati: con il suo servizio di rendering Google è in grado di eseguire gli script necessari alla generazione del Document Object Model (DOM) e, nella maggioranza dei casi, ad analizzare e indicizzare senza problemi il contenuto delle pagine.

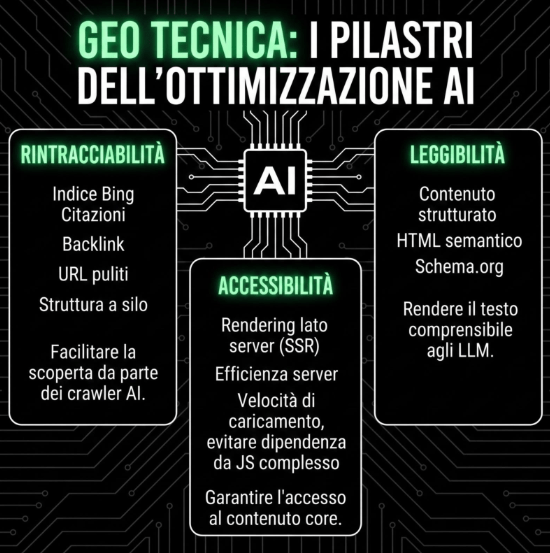

Oggi, tuttavia, la priorità si sposta: dobbiamo concentrarci sull'accessibilità, sulla rintracciabilità e sulla leggibilità dei nostri contenuti per i sistemi AI, i quali operano con logiche e tecnologie meno sofisticate rispetto al colosso di Mountain View.

Accessibilità: la nuova

sfida del rendering

Il primo e più cruciale aspetto della GEO (Generative Engine Optimization) tecnica riguarda l'accessibilità dei contenuti. I nuovi motori basati sull’intelligenza artificiale come ChatGPT si caratterizzano per una limitata o assente capacità di esecuzione di script complessi per il rendering dinamico del contenuto.

I nuovi motori AI-based come ChatGPT sono dotati di una tecnologia di analisi del contenuto decisamente meno evoluta rispetto ai motori tradizionali. Ad oggi, gli LLM non sono in grado di accedere a contenuti che richiedono l'esecuzione di script complessi per essere visualizzati.

Mentre Google se la cava molto bene a eseguire il codice ed effettuare il rendering delle pagine web per indicizzarle — Bing un po’ meno, sebbene disponga di funzionalità di rendering — i motori LLM ad oggi non sono in grado di accedere a contenuti che richiedono l'esecuzione di script complessi per essere visualizzati. Pertanto, un audit tecnico in ottica GEO deve in primo luogo rivalutare come criticità gravi soluzioni tecniche che, pur rispettando le best practice di Google, risultano troppo avanzate per gli LLM.

Altri aspetti da tenere in considerazione sono la velocità di caricamento e l'efficienza del web server, che impattano sulla visibilità nei motori di ricerca tradizionali ma che, nel caso degli LLM, possono portare a conseguenze più problematiche.

I motori di ricerca classici utilizzano lo spider per analizzare il contenuto, che viene poi archiviato in un indice in cui l’algoritmo va a pescare la risposta alle query digitate dall’utenza nell'interfaccia di ricerca. Se la richiesta di scansione non va a buon fine per un problema temporaneo, i bot del motore ritentano l’operazione a più riprese prima di arrendersi e depennare l’URL della risorsa dalla propria lista di crawling.

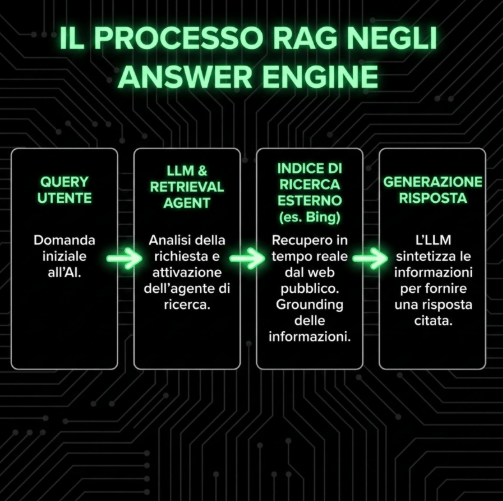

Gli Answer Engine che integrano gli LLM utilizzano il framework RAG (Retrieval-Augmented Generation) per attingere informazioni. Quando lo fanno in tempo reale dal web pubblico, si appoggiano necessariamente a indici di motori di ricerca esistenti, come Bing, non disponendo di un proprio indice globale. Se durante il tentativo di accedere a una pagina questa non risponde in tempi ragionevoli, i loro bot interrompono l'operazione e vanno a cercare l'informazione altrove. Questo significa che un contenuto che non si carica immediatamente e correttamente rischia, di fatto, di restare invisibile.

Rintracciabilità: farsi trovare dai bot LLM

La rintracciabilità dei contenuti per i motori LLM segue un modello completamente diverso rispetto a quanto si verifica con i motori tradizionali, che utilizzano strumenti specifici come le sitemap.xml o l'invio diretto degli URL tramite strumenti dedicati ai webmaster come la Search Console di Google.

Non disponendo di un indice in cui memorizzare le informazioni attinte online, gli LLM non supportano strumenti di inclusione come le sitemap.xml né offrono la possibilità di richiedere l’indicizzazione delle pagine web.

Per aumentare le probabilità che le nostre informazioni vengano "viste" da ChatGPT, che può appoggiarsi all'indice di Bing per generare risposte, è fondamentale sfruttare al massimo tutti gli strumenti di inclusione offerti da quest’ultimo.

Oltre a questi accorgimenti, la rintracciabilità è intrinsecamente legata all'autorità e alla fiducia che il brand ha costruito online. Un sito con forti segnali esterni — come citazioni e backlink di qualità da altri siti e social media — è percepito come autorevole e ha maggiori probabilità di essere selezionato e citato dai motori LLM, che preferiscono attingere informazioni da domini ritenuti affidabili.

Leggibilità: aggiungere contesto ai contenuti

Infine, la leggibilità riguarda la facilità con cui un Answer Engine può estrarre, comprendere e sintetizzare i contenuti per includerli in una risposta. Tra gli obiettivi delle attività GEO c'è anche quello di rendere il parco documentale di un sito quanto più possibile citabile, chiaro e affidabile.

Un altro aspetto tecnico rilevante è quello relativo ai dati strutturati, una sorta di etichette che consentono di esplicitare la natura di determinati elementi all'interno della sorgente HTML delle pagine web. Per anni i SEO si sono concentrati unicamente su un piccolo numero di tipologie e proprietà supportati da Google, con particolare focus su quelli che favorivano i rich result (carousel, rich card, elementi grafici come le stelline delle recensioni etc..), ma l'avvento degli LLM ha schiuso nuove opportunità per sfruttare questo strumento al fine di rendere i contenuti dei siti più visibili nei motori basati sull’AI, che utilizzano qualunque meta-informazione utile a una migliore comprensione dei contenuti di una pagina.

Per capire di quanto le opportunità siano aumentate, basti pensare che gli schemi attualmente disponibili si compongono di oltre 800 tipi e 1500 proprietà.

Un aspetto interessante in fase di discussione è l'introduzione di un file LLMs.txt contenente informazioni chiave sul dominio in formato markdown. Questo file — che, come il robots.txt, dovrebbe essere posizionato nella cartella principale del sito — potrebbe teoricamente facilitare il recupero in tempo reale delle informazioni importanti da parte degli LLM. Ad oggi, però, i principali provider di LLM non hanno confermato di supportare questo file, e inoltre si solleva il potenziale rischio di abusi in forma di spam da parte dei webmaster.

La rivoluzione AI ha allungato la lista dei controlli tecnici, cambiando radicalmente i criteri di giudizio delle soluzioni un tempo considerate best practice. È tempo di monitorare la visibilità del brand in un ambiente answer-first.

Conclusioni

In conclusione, è innegabile che la rivoluzione AI nell'ambito della ricerca online abbia già avuto un impatto significativo sulle attività di ottimizzazione tecnica finalizzate al miglioramento della visibilità dei siti nelle risposte dei nuovi modelli, allungando la lista dei controlli e cambiando radicalmente i criteri di giudizio di determinate soluzioni tecniche un tempo in linea con le best practice.

Dopo aver completato l’ottimizzazione tecnica di base, è necessario verificare l’impatto delle attività sulla sua visibilità nei responsi dei modelli LLM, con un monitoraggio decisamente diverso da quello classico dei rank analyzer tradizionali. Dato che questo tipo di monitoraggio serve anche e soprattutto per delineare strategie di contenuto nel nuovo scenario, avremo modo di approfondire la tematica nell’articolo dedicato all’impatto della rivoluzione AI sulla content strategy.

Prossimamente: L'impatto AI sulla Content Strategy